- 1. Position concrète du problème

- 2. Axiomatique

- 3. Instruments de travail

- 4. Lois et fonctions caractéristiques fondamentales

- 5. Arithmétique des lois de probabilités

- 6. Inégalités et équivalences

- 7. Topologie aléatoire

- 8. Lois des grands nombres et théorème central limite

- 9. Certaines lois de probabilités

- 10. Chaînes de Markov et martingales

- 11. Quelques problèmes simples

- 12. Bibliographie

PROBABILITÉS CALCUL DES

- Article mis en ligne le

- Modifié le

- Écrit par Daniel DUGUÉ

Instruments de travail

Lois de répartition

La fin du chapitre précédent a attiré l'attention sur le cas où (Ω1, B1) est l'espace Rn muni de la tribu borélienne. Dans ce cas, l'ensemble (X1, ..., Xn) des n coordonnées d'un point constitue la variable aléatoire et l'on peut introduire une fonction de n variables x1, ..., xn :

On lui donne le nom de loi de probabilité (ou fonction de répartition) de la variable aléatoire considérée. C'est une fonction non décroissante de l'ensemble des n coordonnées. Dans le cas d'une coordonnée, la fonction F(x) non décroissante se décompose, selon le résultat classique de Lebesgue, en une somme :

La décomposition F = F1 + F2 + F3 est unique ; bien entendu, une ou deux des fonctions Fi peuvent être nulles.

La définition :

Fonction caractéristique

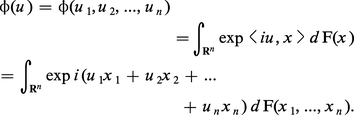

Parallèlement à la fonction de répartition, le calcul des probabilités utilise la fonction caractéristique, introduite par H. Poincaré, puis, sous sa forme actuelle, par P. Lévy, donnée par l'intégrale de Lebesgue-Stieltjes :

Le passage de la fonction ϕ à la fonction F se fait par l'intermédiaire de la formule d'inversion de Fourier. Si la fonction de répartition est continue sur la frontière du pavé :

La fonction caractéristique possède plusieurs propriétés qui rendent son emploi fréquent en calcul des probabilités. La première propriété est topologique : Si une suite F1, F2, ..., Fn, ... de fonctions de répartition converge en tout point de Rn vers une fonction de répartition limite F, alors la suite ϕ1, ..., ϕn, ... des fonctions converge, uniformément, dans tout domaine borné contenant l'origine, vers la fonction caractéristique ϕ de F. Cet énoncé admet la réciproque suivante, souvent utilisée : Si en tout point de Rn la suite ϕ1, ..., ϕn, ... converge vers une fonction[...]

La suite de cet article est accessible aux abonnés

- Des contenus variés, complets et fiables

- Accessible sur tous les écrans

- Pas de publicité

Déjà abonné ? Se connecter

Écrit par

- Daniel DUGUÉ : directeur de l'Institut statistique de l'université de Paris-VI

Classification

Pour citer cet article

Daniel DUGUÉ. PROBABILITÉS CALCUL DES [en ligne]. In Encyclopædia Universalis. Disponible sur : (consulté le )

Article mis en ligne le et modifié le 14/03/2009

Médias

Autres références

-

PRIX ABEL 2020

- Écrit par Jean-François QUINT

- 1 824 mots

- 2 médias

Le prix Abel 2020 a été attribué conjointement à Hillel Furstenberg et Gregory Margulis « pour l'utilisation visionnaire de méthodes issues de la théorie des probabilités et de celles des systèmes dynamiques en théorie des groupes, théorie des nombres et combinatoire ».

Hillel...

-

ACTUARIAT & ACTUAIRES

- Écrit par Georges BLUMBERG

- 157 mots

L'activité appelée actuariat, accomplie par des actuaires, consiste à faire des calculs de probabilités à partir de renseignements statistiques. Ces calculs sont le plus souvent destinés à établir des taux de primes d'assurance en tenant compte de la fréquence des risques courus : mortalité, maladie,...

-

ARS CONJECTANDI, Jacob Bernoulli

- Écrit par Bernard PIRE

- 377 mots

Le traité Ars conjectandi (« Art de la conjecture ») est l'ouvrage le plus important du mathématicien suisse Jacob Bernoulli (1654-1705). Écrit de 1684 à 1689 lorsque Bernoulli enseigne la mécanique à l'université de Bâle, cet ouvrage resté incomplet fut publié en 1713, huit ans après la mort de l'auteur....

-

ASSURANCE - Histoire et droit de l'assurance

- Écrit par Jean-Pierre AUDINOT , Encyclopædia Universalis et Jacques GARNIER

- 7 490 mots

- 1 média

Pour que cet aléa disparaisse, il fallut attendre que la découverte du calcul des probabilités et le progrès de l'observation statistique permettent une prévision rationnelle du risque. Mais ce n'est qu'au xviie siècle que Pascal, à la demande d'un joueur de cartes passionné, le... - Afficher les 63 références